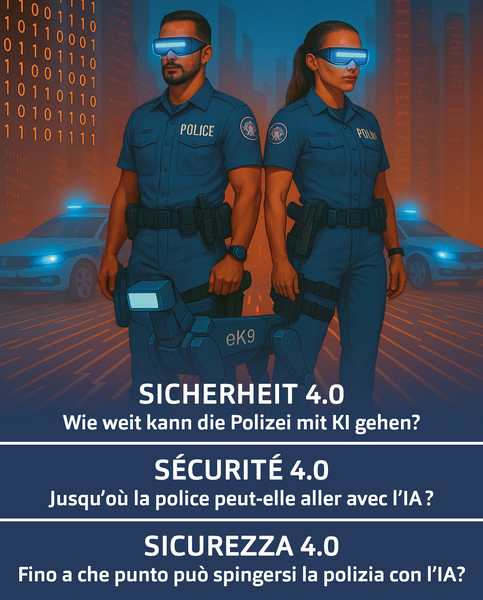

19° Forum «Sicurezza interna»® 04.11.2025 Casinò Berna

Sicurezza 4.0 – Fino dove può spingersi la polizia con l'IA?

L'intelligenza artificiale (AI) è onnipresente: la maggior parte delle persone ha già avuto a che fare con essa o lo farà presto. Anche il lavoro della polizia non ne è esente. Fake news, robocop in servizio, IA come partner negli interventi, formazione virtuale nel metaverso. Le possibilità sono molte e varie, ma alla fine cosa è effettivamente utile? Alcuni modelli di IA possono addirittura alleviare la carenza di personale? L'uso dell'intelligenza artificiale nel settore della polizia offre sia opportunità che rischi. Le varie tecnologie possono aumentare l'efficienza e la precisione del lavoro della polizia, ma presentano anche delle sfide.

Grazie all'intelligenza artificiale, la polizia può, ad esempio, prevedere più rapidamente i reati o aumentare la propria efficienza investigativa. Grazie al monitoraggio automatizzato e al rilevamento precoce di attività sospette, è possibile rafforzare l'analisi delle prove e quindi il lavoro di prevenzione.

D'altro canto, esistono rischi quali la violazione della privacy, la mancanza di trasparenza, la suscettibilità del sistema agli errori, l'insufficiente controllo umano e il pericolo di attacchi esterni.

L'introduzione dell'IA nelle forze di polizia ha il potenziale per migliorare la sicurezza e aumentare l'efficienza, ma richiede un'attenta regolamentazione e considerazioni etiche. Le tecnologie devono essere utilizzate in modo da rispettare i diritti dei cittadini ed evitare potenziali pregiudizi o abusi. È fondamentale un equilibrio tra l'uso della tecnologia e il controllo umano

Durante il Forum sulla Sicurezza Interna della FSFP, faremo luce su vari aspetti. Scopriremo quali tendenze dell'IA vengono attualmente utilizzate nel lavoro di polizia, quali tecnologie sono già in uso e quali modelli di IA non possono essere implementati. Analizzeremo come l'uso dell'IA differisce in Svizzera rispetto ad altri Paesi e se le forze di polizia sono preparate all'uso di questa tecnologia.

Siamo felici di dare il benvenuto anche quest'anno a personalità di spicco del mondo della politica, della scienza e della pratica al nostro forum «Sicurezza interna»:

Olivier Ribaux, Professore presso la Scuola

di scienze criminali dell'Università di Losanna

L'intelligenza artificiale (IA) sta accelerando le trasformazioni digitali che hanno già profondamente influenzato il lavoro della polizia. L'obiettivo principale è quello di aumentare l'efficienza. L'IA interviene nell'assistenza alla redazione di rapporti, nelle trascrizioni, nelle traduzioni, nel riconoscimento biometrico, nell'elaborazione dei dati... Questi strumenti promettono di agire più rapidamente, meglio e su scala più ampia. Numerosi rapporti internazionali raccomandano un quadro etico e giuridico, l'adeguamento delle organizzazioni e dei processi, il rafforzamento delle infrastrutture e una formazione mirata.

Ma è sufficiente? Il cambiamento non riguarda solo gli strumenti. Riguarda la natura stessa della criminalità e delle risposte da dare. Non basta fare “più dello stesso”: si possono davvero affrontare minacce nuove con schemi vecchi?

In questa emergenza tecnologica, c'è il rischio di costruire risposte senza aver compreso a fondo il problema.

Ciò che ancora manca è una conoscenza approfondita dell'integrazione delle diverse forme di IA nelle strutture criminali, del loro potenziale in nuove strategie di risposta e delle loro successive evoluzioni.

In sintesi, è necessario un programma di ricerca a lungo termine, in grado di identificare con precisione gli usi, le capacità, i rischi e i limiti dell'IA, al fine di chiarire progressivamente le scelte cruciali che si impongono nella pratica.

Dr. Jean-Marc Rickli, Head of Global and Emerging Risks

Geneva Centre for Security Policy (GCSP)

I recenti progressi dell'intelligenza artificiale, sostenuti dalla crescente potenza di calcolo, dall'aumento del volume dei dati generati e dal miglioramento degli algoritmi di apprendimento automatico, hanno portato a importanti innovazioni quali la serie di algoritmi Alpha di Deepmind di Google o ChatGPT di OpenAI.

La velocità di questa crescita tecnologica è esponenziale e la sua diffusione è sia orizzontale (tra Stati) che verticale (dagli attori statali a quelli non statali). Ciò apre prospettive allarmanti circa i potenziali usi malevoli di questa tecnologia e i mezzi per prevenirli. Inoltre, evoluzioni simili si osservano in altre tecnologie emergenti come l'informatica quantistica, le nanotecnologie, le neuroscienze o la biologia sintetica.

La convergenza di queste tecnologie apre la strada a progressi scientifici considerevoli, con implicazioni molto positive per l'umanità. Tuttavia, a causa della rapida democratizzazione di queste tecnologie, non si può escludere il rischio di un uso improprio e, soprattutto, malevolo. Ciò ha un impatto diretto sul lavoro delle forze di polizia. Da un lato, queste tecnologie creano nuovi rischi che richiedono nuove competenze e, dall'altro, possono anche migliorare il lavoro della polizia, in particolare nel campo della scienza forense.

Martina Arioli, Avvocata, lic. iur. LL.M.

L'IA sta trasformando il lavoro della polizia e in questo contesto sono indispensabili dei vincoli giuridici. La Svizzera ratificherà la Convenzione sull'IA del Consiglio d'Europa e la trasporrà nel diritto svizzero in modo settoriale. Poiché la Confederazione non regola direttamente l'uso dell'IA a livello cantonale per mancanza di competenza, a livello cantonale sorgono incertezze giuridiche. I Cantoni si trovano ad affrontare la sfida di regolamentare autonomamente l'uso dell'IA senza sapere quale sarà la portata delle revisioni a livello federale. Tuttavia, già oggi esistono chiare direttive del Tribunale federale: la sorveglianza basata sull'IA, come la ricerca automatizzata di veicoli e il riconoscimento facciale, è consentita solo con una base giuridica sufficientemente precisa.

La decisione sulla legge di polizia di Lucerna del 17 ottobre 2024 lo ha chiarito e obbliga i Cantoni a emanare norme precise in materia di limitazione delle finalità, termini di conservazione e meccanismi di controllo. Anche l'attuale dibattito sulla revisione della legge di polizia di Zurigo sottolinea che le leggi cantonali devono disciplinare l'uso dell'IA in modo differenziato, trasparente e conforme ai diritti fondamentali.

L'esempio dell'acquisto del sistema automatizzato di identificazione delle impronte digitali (AFIS), la revisione della legge federale sui sistemi d'informazione di polizia della Confederazione (BPI) e la futura piattaforma nazionale di consultazione POLAP mostrano quanto l'uso dell'IA influisca sul trattamento dei dati personali particolarmente sensibili.

La polizia necessita di basi legali chiare per l'utilizzo dell'IA nella prevenzione di minacce allo Stato di diritto. La questione centrale rimane quella di come conciliare l'efficienza tecnologica e la tutela dei diritti fondamentali.

Holger Münch, Presidente dell'Ufficio Federale

dalla Polizia Criminale Tedesca (Bundeskriminalamt)

L'intelligenza artificiale pone nuove sfide alle autorità di sicurezza, ma allo stesso tempo offre nuove opportunità. I criminali utilizzano gli strumenti di intelligenza artificiale in modo creativo, intensificando gli attuali sviluppi della criminalità.

Ad esempio, la creazione di e-mail di phishing, deepfake o malware è ora possibile anche per persone senza conoscenze tecniche preliminari. Inoltre, l'uso dell'IA rende più facile sfruttare le vulnerabilità dei sistemi informatici. Allo stesso tempo, l'IA offre anche opportunità innovative per le moderne autorità di sicurezza: l'automazione, il riconoscimento facciale o l'analisi di grandi quantità di dati possono supportare le indagini. L'IA può esserci d'aiuto anche nell'amministrazione: i chatbot digitali consentono un accesso agevole alle informazioni o facilitano la corrispondenza. Questo aumento di efficienza consente ai nostri collaboratori di concentrarsi sui loro compiti principali. Per questo motivo è importante riflettere su nuove possibilità di impiego dell'IA e continuare a sviluppare la tecnologia.

Infine, anche i poteri giuridici sono decisivi, perché solo con condizioni quadro vincolanti è possibile un'efficace azione penale. L'IA fa parte del futuro, anche come parte delle autorità di sicurezza.

Matteo Cocchi, Presidente della Conferenza

delle Comandante e dei Comandanti

delle Polizie Cantonali della Svizzera (CCPCS)

Comandante della Polizia Cantonale del Ticino

L’utilizzo dell’intelligenza artificiale (IA) da parte della polizia è una delle più recenti frontiere della sicurezza pubblica. Strumenti come l’analisi predittiva dei reati, i sistemi di sorveglianza automatizzata, agevolazioni per traduzioni e trascrizioni nonché supporti elettronici d’indagine promettono di rendere più efficienti le attività investigative e di prevenzione. I vantaggi sono evidenti: maggiore rapidità nell’identificazione dei sospetti, ottimizzazione delle risorse operative e possibilità di anticipare situazioni di rischio.

Tuttavia, l’impiego dell’IA pone interrogativi etici e giuridici. L’uso massiccio di dati sensibili può minare la privacy, mentre il rischio di errori, frutto di dati falsati, impone cautela. Per questi motivi, bisogna creare una base giuridica che preveda limiti definiti per il suo utilizzo. In Svizzera attualmente non esiste una normativa federale specifica per regolamentare l’utilizzo dell’IA in polizia, ma il suo impiego è soggetto al rispetto della Legge sulla protezione dei dati e ai principi dello Stato di diritto.

In conclusione, l’IA offre opportunità per la sicurezza, ma richiede un uso responsabile, trasparente e regolamentato per non compromettere le attività investigative, attraverso l’uso di dati non verificati, e le libertà individuali. Anche in questo ambito, etica e deontologia degli agenti giocheranno un ruolo fondamentale.

Stefan Aegerter, Direttore dell'Istituto

Svizzero di Polizia (ISP)

L'intelligenza artificiale (IA) sta entrando nella formazione della polizia e offre più opportunità che rischi. Il concetto globale di politica formativa (BGK) (vedere bgk-cgf.ch) tiene già conto delle competenze future che saranno influenzate dall'IA.

Le simulazioni basate sull'IA consentono alle forze di polizia di addestrarsi in scenari imprevedibili, dalle conversazioni volte a placare le tensioni alle complesse operazioni di intervento in spazi virtuali. Se utilizzata in modo sensato, l'IA può aumentare l'effetto di apprendimento e ottimizzare le risorse. Tuttavia, l'essere umano rimane al centro: l'intuizione, l'esperienza e l'etica non possono essere sostituiti da alcun algoritmo. L'IA deve facilitare l'apprendimento, non sostituire le persone.

Ecco perché è fondamentale trovare un equilibrio tra tecnologia e controllo. I critici spesso citano la protezione dei dati, e a ragione. Proprio per questo è compito della formazione sensibilizzare le future forze dell'ordine a un uso responsabile dei dati, alla trasparenza e alla proporzionalità.

Studi internazionali dimostrano che laddove la protezione dei dati e l'etica sono state integrate nella formazione, aumenta anche l'accettazione delle nuove tecnologie. Esempi provenienti dagli Stati Uniti o dai Paesi Bassi dimostrano come l'IA venga utilizzata, ad esempio, nella formazione sulla deescalation o nell'analisi dei crimini informatici. Per la polizia svizzera vale il principio seguente: non dobbiamo chiuderci alla realtà digitale, perché la sicurezza di domani richiede agenti di polizia competenti, che utilizzino l'IA in modo critico e la padroneggino in modo responsabile.

Sponsor d'oro

Sponsor d'argento