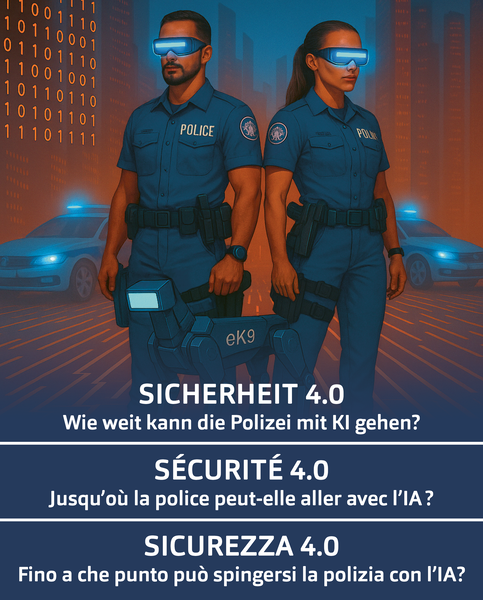

19e Forum «Sécurité intérieure»® 04.11.2025 Casino Berne

Sécurité 4.0 - Jusqu'où la police peut-elle aller avec l'IA ?

L'intelligence artificielle (IA) est omniprésente - la plupart des gens y ont déjà été confrontés ou le seront bientôt. Le travail de la police n'est pas épargné. Fake news, robocops dans les services, IA comme partenaire lors d'interventions, entraînements virtuels dans le métavers. Les possibilités sont nombreuses, mais qu’est-ce qui est réellement utile ? Certains modèles d'IA peuvent-ils même remédier à la pénurie de personnel ? L'utilisation de l'intelligence artificielle dans le domaine de la police offre à la fois des opportunités et des risques. Les différentes technologies peuvent accroitre l'efficacité et la précision du travail de la police, mais elles posent également des défis. Les 'intelligence artificielle peuvent pour améliorer l'efficacité et la précision du travail de la police.

Grâce à l'IA, la police peut par exemple prévoir plus rapidement les crimes ou accroitre l'efficacité de ses enquêtes. La surveillance automatisée et la détection précoce des activités suspectes permettent de renforcer l’analyse des preuves et donc le travail de prévention.

En contrepartie, il existe des risques tels que la violation de la vie privée, le manque de transparence, la vulnérabilité du système, un contrôle humain insuffisant ainsi que le risque d'attaques externes.

L'introduction de l'IA dans le travail de la police a le potentiel d'accroitre la sécurité et l'efficacité, mais elle nécessite une réglementation minutieuse et des considérations éthiques. Les technologies doivent être utilisées de manière à préserver les droits des citoyens et à éviter d'éventuelles distorsions ou abus. Il est essentiel de trouver un juste équilibre entre l'utilisation de la technologie et le contrôle humain.

Lors du Forum sur la Sécurité Intérieure de la FSFP, nous aborderons différents points de vue. Nous découvrirons quelles sont les tendances actuelles en matière d'IA dans le travail de la police, quelles technologies sont déjà utilisées et quels modèles d'IA ne sont pas applicables. Nous examinerons en quoi l’utilisation de l'IA en Suisse diffère de celle d'autres pays et si les polices sont préparées à l'utilisation de l'intelligence artificielle.

On est super contents d'accueillir cette année encore des personnalités reconnues issues des milieux politiques, scientifiques et professionnels à notre forum « Sécurité intérieure » :

Olivier Ribaux, Professeur à l’École

des sciences criminelles de l’Université de Lausanne

L’intelligence artificielle (IA) accélère les transformations numériques qui ont déjà profondément influencé le travail policier. L’objectif principal est de gagner en efficacité. Elle intervient dans l’aide à la rédaction de rapports, les transcriptions, les traductions, la reconnaissance biométrique, le traitement de données… Ces outils promettent d’agir plus vite, mieux, à plus grande échelle. De nombreux rapports internationaux recommandent un cadre éthique et juridique, l’adaptation des organisations et des processus, le renforcement des infrastructures ainsi qu’une formation ciblée.

Mais est-ce suffisant ? Le changement ne concerne pas seulement les outils. Il touche à la nature même de la criminalité et des réponses à y apporter. Il ne suffit pas de faire « plus de la même chose » : peut-on vraiment affronter des menaces nouvelles avec des schémas anciens ?

Dans cette urgence technologique, il existe un risque de construire des réponses sans avoir suffisamment compris le problème.

Ce qui manque encore, c’est une connaissance approfondie de l’intégration des différentes formes d’IA dans les structures criminelles, de leur potentiel dans de nouvelles stratégies de réponse, et de leurs évolutions successives.

En somme, il faut un programme de recherche inscrit dans la durée, capable de cerner avec précision les usages, les capacités, les risques et les limites de l’IA, afin d’éclairer progressivement les choix cruciaux qui s’imposent dans les pratiques.

Dr. Jean-Marc Rickli, Head of Global and Emerging Risks

Geneva Centre for Security Policy (GCSP)

Les progrès récents de l'intelligence artificielle, portés par la puissance de calcul croissante, l'augmentation du volume de données générées et l'amélioration des algorithmes d'apprentissage automatique, ont conduit à des avancées majeures telles que la série d'algorithmes Alpha de Deepmind de Google ou ChatGPT d'OpenAI.

La vitesse de cette croissance technologique est exponentielle et sa prolifération est à la fois horizontale (entre États) et verticale (des acteurs étatiques aux acteurs non étatiques). Cela ouvre des perspectives alarmantes quant aux utilisations potentiellement malveillantes de cette technologie et aux moyens de les prévenir. Par ailleurs, des évolutions similaires peuvent être observées dans d'autres technologies émergentes telles que l'informatique quantique, les nanotechnologies, les neurosciences ou la biologie synthétique.

La convergence de ces technologies ouvre la voie à des avancées scientifiques considérables, aux implications très positives pour l'humanité. Cependant, en raison de la démocratisation rapide de ces technologies, le risque d'utilisations abusives, et surtout malveillantes, ne peut être exclu. Ceci implique directement le travail des forces de police. D’une part ces technologies créent de nouveaux risques qui requièrent de nouvelles compétences et d’autre part, ces technologies peuvent également améliorer le travail de la police notamment dans le domaine forensique.

Martina Arioli, Avocate, lic. iur., LL.M.

L'IA modifie le travail de la police – des garde-fous juridiques sont indispensables dans ce contexte. La Suisse ratifiera la convention du Conseil de l'Europe sur l'IA et la transposera dans le droit suisse de manière sectorielle. Comme la Confédération ne réglemente pas directement l'utilisation de l'IA au niveau cantonal faute de compétence, des incertitudes juridiques apparaissent au niveau cantonal. Les cantons sont confrontés au défi de réglementer de manière autonome l'utilisation de l'IA sans savoir jusqu'où iront les révisions au niveau fédéral. Cependant, il existe déjà aujourd'hui des directives claires de la Cour fédérale : la surveillance assistée par l'IA, telle que la recherche automatisée de véhicules et la reconnaissance faciale, n'est autorisée que si elle repose sur une base légale suffisamment précise.

La décision relative à la loi sur la police lucernoise du 17 octobre 2024 l'a clairement établi et oblige les cantons à adopter des réglementations précises en matière de limitation de la finalité, de délais de conservation et de mécanismes de contrôle. Le débat actuel sur la révision de la loi sur la police zurichoise souligne également que les lois cantonales doivent réglementer l'utilisation de l'IA de manière différenciée, transparente et conforme aux droits fondamentaux.

L'exemple de l'acquisition du système automatisé d'identification des empreintes digitales (AFIS), de la révision de la loi fédérale sur les systèmes d'information de police de la Confédération (LIPC) et de la future plateforme nationale de consultation POLAP montre à quel point l'utilisation de l'IA affecte le traitement des données personnelles particulièrement sensibles.

La police a besoin de bases légales claires pour utiliser l'IA dans le but de prévenir les menaces à l'État de droit. La question centrale reste de savoir comment concilier l'efficacité technologique et la protection des droits fondamentaux.

Holger Münch, Président de l'Office Fédéral

de Police Criminelle (Bundeskriminalamt)

L'intelligence artificielle pose de nouveaux défis aux autorités chargées de la sécurité, mais leur offre également de nouvelles opportunités. Les criminels utilisent les outils d'IA de manière créative, ce qui renforce les tendances actuelles en matière de criminalité.

Ainsi, la création de courriels de phishing, de deepfakes ou de logiciels malveillants est désormais accessible même aux personnes sans connaissances techniques préalables. De plus, l'utilisation de l'IA facilite l'exploitation des failles des systèmes informatiques. Parallèlement, l'IA offre également des possibilités innovantes aux autorités chargées de la sécurité modernes : l'automatisation, la reconnaissance faciale ou l'analyse de grandes quantités de données peuvent faciliter les enquêtes. L'IA peut également nous aider dans le domaine administratif : les chatbots numériques permettent un accès facile à l'information ou facilitent la correspondance. Ce gain d'efficacité permet à nos collaborateurs de se concentrer sur leurs tâches principales. C'est pourquoi il est important de réfléchir à de nouvelles applications de l'IA et de continuer à développer la technologie.

Enfin, les pouvoirs juridiques sont également déterminants, car seules des conditions-cadres contraignantes permettent une poursuite pénale efficace. L'IA fait partie de l'avenir, y compris dans le cadre des autorités chargées de la sécurité.

Matteo Cocchi, Président de la Conférence

des Commandantes et des Commandants

des polices cantonales de Suisse (CCPCS)

Commandant de la police cantonale du Tessin

L'utilisation de l'intelligence artificielle (IA) par la police est l'une des dernières frontières de la sécurité publique. Des outils tels que l'analyse prédictive des crimes, les systèmes de surveillance automatisée, les aides à la traduction et à la transcription ainsi que les supports électroniques d'enquête promettent de rendre les activités d'enquête et de prévention plus efficaces.

Les avantages sont évidents : identification plus rapide des suspects, optimisation des ressources opérationnelles et possibilité d'anticiper les situations à risque.

Toutefois, l'utilisation de l'IA soulève des questions éthiques et juridiques. L'utilisation massive de données sensibles peut porter atteinte à la vie privée, tandis que le risque d'erreurs, résultant de données falsifiées, impose la prudence. Pour ces raisons, il est nécessaire de créer une base juridique prévoyant des limites claires à son utilisation. En Suisse, il n'existe actuellement aucune réglementation fédérale spécifique régissant l'utilisation de l'IA par la police, mais son utilisation est soumise au respect de la loi sur la protection des données et aux principes de l'État de droit.

En conclusion, l'IA offre des opportunités en matière de sécurité, mais son utilisation doit être responsable, transparente et réglementée afin de ne pas compromettre les activités d'enquête par l'utilisation de données non vérifiées et de ne pas porter atteinte aux libertés individuelles. Dans ce domaine également, l'éthique et la déontologie des agents joueront un rôle fondamental.

Stefan Aegerter, Directeur de l'Institut

Suisse de Police (ISP)

L'intelligence artificielle (IA) fait son entrée dans la formation policière, et elle offre plus d'opportunités que de risques. Le concept global de la politique de formation (BGK) (voir bgk-cgf.ch) tient déjà compte des compétences d'avenir qui seront façonnées par l'IA.

Les simulations basées sur l'IA permettent ainsi de former les forces de police à des scénarios imprévisibles, allant de la désescalade verbale à des exercices d'intervention complexes dans un espace virtuel. Utilisée à bon escient, l'IA peut améliorer l'apprentissage et optimiser les ressources. Cependant, l'être humain reste au centre : l'intuition, l'expérience et l'éthique ne peuvent être remplacées par aucun algorithme. L'IA doit faciliter l'apprentissage, pas remplacer les personnes. C'est pourquoi l'équilibre entre technologie et contrôle est essentiel. Les détracteurs invoquent souvent la protection des données, à juste titre. C'est précisément pour cette raison que la formation doit sensibiliser les futurs agents à une utilisation responsable des données, à la transparence et à la proportionnalité. Des études internationales montrent que lorsque la protection des données et l'éthique sont fermement intégrées dans la formation, l'acceptation des nouvelles technologies augmente également.

Des exemples aux États-Unis ou aux Pays-Bas montrent comment l'IA est utilisée, par exemple dans les formations à la désescalade ou l'analyse de la cybercriminalité. Pour la police suisse, il est clair que nous ne devons pas nous fermer à la réalité numérique, car la sécurité de demain exige des policiers compétents, capables d'utiliser l'IA de manière critique et de la maîtriser de manière responsable.

Sponsors d'or

Sponsors d'argent